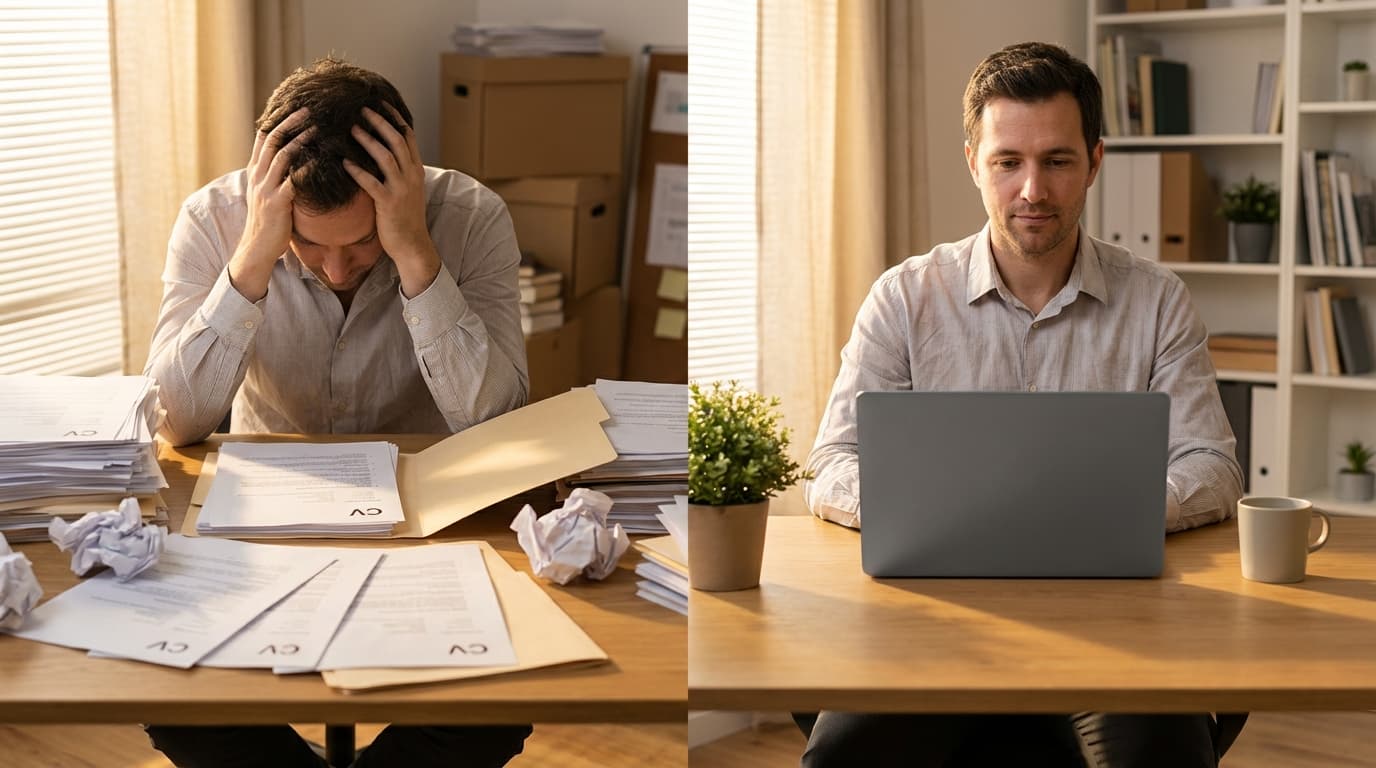

On vous a promis que l’IA changerait tout. La réalité ?

Des collaborateurs qui bidouillent chacun dans son coin. Des données clients collées dans ChatGPT. Des documents confidentiels traduits par des outils gratuits dont personne ne connaît les conditions d’utilisation.

C’est le Shadow AI. Et c’est probablement déjà dans votre entreprise.

L’ampleur du phénomène : les chiffres parlent

Commençons par ce qui devrait vous empêcher de dormir : selon une étude Salesforce menée auprès de 14 000 travailleurs dans 14 pays, plus de la moitié des utilisateurs d’IA générative en entreprise utilisent des outils non approuvés par leur employeur (Salesforce, “The Promises and Pitfalls of AI at Work”, 2024). Pire : 64 % d’entre eux ont déjà fait passer un travail généré par IA comme étant le leur.

Et ne croyez pas que ce sont les stagiaires. Une enquête UpGuard de 2024 révèle que 93 % des cadres dirigeants et managers seniors utilisent eux-mêmes des outils IA non approuvés au travail (UpGuard, 2024). Le Shadow AI vient d’en haut.

Côté résistance aux interdictions, le constat est encore plus brutal : 46 % des utilisateurs de Shadow AI déclarent qu’ils continueraient même si l’outil était explicitement interdit par leur organisation (Software AG, 2024). Autrement dit, une politique d’interdiction pure et simple ne fonctionne pas.

Gartner anticipe que d’ici 2030, plus de 40 % des organisations mondiales subiront des incidents de sécurité ou de conformité directement liés à l’utilisation d’outils IA non autorisés (Gartner, “Emerging Risk Deep Dive: Shadow AI”, 2025). Ce n’est pas un scénario catastrophe. C’est une projection basée sur la trajectoire actuelle.

Ce que ça ressemble, concrètement

Le Shadow AI n’a rien de spectaculaire. C’est du quotidien, de l’invisible, du banal :

-

Le commercial qui copie-colle la fiche client complète — nom, chiffre d’affaires, historique de commandes — dans ChatGPT pour rédiger une proposition en 10 minutes au lieu d’une heure. Les données sont stockées sur des serveurs américains, potentiellement utilisées pour l’entraînement du modèle.

-

La responsable RH qui soumet des comptes-rendus d’entretiens annuels à un outil IA pour en faire une synthèse. Dedans : noms, évaluations de performance, données salariales. Des données personnelles sensibles au sens du RGPD.

-

Le comptable qui fait analyser un bilan financier confidentiel par un modèle gratuit en ligne. Aucune garantie de confidentialité, aucune traçabilité.

-

L’assistante de direction qui traduit un accord de partenariat confidentiel via un traducteur IA dont les CGU autorisent la réutilisation des contenus soumis.

Ce n’est pas de la malveillance. C’est du pragmatisme. Ces outils font gagner du temps — et personne ne leur a donné d’alternative.

Samsung l’a appris à ses dépens : en mars 2023, des ingénieurs ont soumis du code source confidentiel et des notes de réunion internes à ChatGPT. Résultat : des secrets industriels irrécupérables, désormais intégrés dans les données d’OpenAI (The Economist, Gizmodo, avril 2023). Samsung a dû interdire temporairement l’outil à l’ensemble de ses 270 000 employés.

Le coût réel du Shadow AI

Parlons argent, puisque c’est souvent le seul langage qui fait bouger les choses.

Le coût d’une fuite de données atteint en moyenne 4,88 millions de dollars au niveau mondial en 2024, soit une hausse de 10 % par rapport à 2023 — la plus forte augmentation annuelle depuis la pandémie (IBM, “Cost of a Data Breach Report”, 2024). Et pour les organisations qui ne maîtrisent pas leurs outils IA, ce coût explose : pas de détection rapide, pas de périmètre défini, pas de réponse préparée.

Les sanctions RGPD sont loin d’être théoriques. En 2024, la CNIL a prononcé 87 sanctions pour un montant total de 55,2 millions d’euros (CNIL, rapport annuel 2024). Le nombre de sanctions a doublé par rapport à 2023. Et le détail qui devrait alerter chaque dirigeant de PME : près de 8 sanctions sur 10 ont visé des TPE/PME (CNIL, bilan des sanctions 2024). Les gros ne sont plus les seules cibles.

En parallèle, les violations de données personnelles notifiées à la CNIL ont bondi de 20 % en un an, atteignant 5 629 cas en 2024. Le nombre de violations touchant plus d’un million de personnes a doublé (CNIL, rapport annuel 2024).

Ajoutez-y le coût invisible : la perte de confiance client, l’atteinte à la réputation, le temps des équipes juridiques, la désorganisation interne. Pour une PME, un seul incident peut être existentiel.

Le cadre réglementaire se durcit

Le RGPD n’est plus seul. Depuis le 2 février 2025, les premières obligations de l’EU AI Act sont entrées en application : les pratiques d’IA interdites sont désormais sanctionnables, et les entreprises doivent garantir une “littératie IA” suffisante parmi les salariés impliqués dans l’utilisation de systèmes d’IA (Règlement UE 2024/1689, article 4). Les amendes peuvent atteindre 35 millions d’euros ou 7 % du chiffre d’affaires annuel mondial pour les infractions les plus graves.

Concrètement : si vos équipes utilisent des outils IA sans formation, sans documentation, sans traçabilité — vous êtes en infraction potentielle depuis février 2025.

Côté cybersécurité, l’ANSSI a traité 4 386 événements de sécurité en 2024, en hausse de 15 % (ANSSI, Panorama de la cybermenace 2024). Les PME/TPE/ETI représentent 37 % des victimes de rançongiciels connues de l’agence. Le Shadow AI élargit la surface d’attaque de manière incontrôlée.

Ce qu’il faut faire — vraiment

La solution n’est pas d’interdire l’IA. Les chiffres le prouvent : 46 % des utilisateurs s’en moquent. Et interdire un outil qui rend les gens plus productifs, c’est se battre contre la réalité.

La solution, c’est de reprendre le contrôle :

-

Auditer immédiatement. Cartographiez tous les outils IA utilisés dans votre entreprise, officiels ou non. Interrogez les équipes sans les culpabiliser. L’objectif est la transparence, pas la sanction.

-

Classifier les risques. Tous les usages ne se valent pas. Un commercial qui utilise l’IA pour reformuler un email n’a pas le même profil de risque qu’un comptable qui soumet des bilans financiers.

-

Déployer des alternatives souveraines. Des solutions IA hébergées en France, conformes RGPD, avec des données qui restent dans vos murs. C’est exactement ce type d’infrastructure que des acteurs comme Kloviss mettent en place pour les PME — des outils aussi performants que ChatGPT, mais dont vous gardez la maîtrise.

-

Former, pas punir. Mettez en place une charte IA claire. Formez chaque collaborateur aux bonnes pratiques et aux risques. Rappelez que l’obligation de littératie IA est désormais légale (EU AI Act, article 4).

-

Monitorer en continu. Un audit ponctuel ne suffit pas. Les outils IA évoluent chaque semaine, et de nouveaux usages non autorisés apparaîtront. Intégrez la veille Shadow AI dans votre gouvernance.

-

Documenter pour la conformité. L’EU AI Act exige une traçabilité. Qui utilise quoi, pour quel usage, avec quelles données. Si vous ne pouvez pas répondre à cette question aujourd’hui, vous avez un problème.

Le mot de la fin

Le Shadow AI n’est pas un problème technique. C’est un problème de management. Vos collaborateurs ont trouvé des outils qui les rendent plus efficaces, et ils n’ont pas attendu votre permission — parce que vous ne leur avez rien proposé.

Chaque jour sans cadre, ce sont des données clients, des informations stratégiques et des documents confidentiels qui transitent par des serveurs dont vous ignorez jusqu’à la localisation. Chaque jour sans alternative, c’est un risque réglementaire, financier et réputationnel qui grandit.

La question n’est plus de savoir si le Shadow AI existe dans votre entreprise. La question est : combien de temps encore allez-vous faire semblant de ne pas le voir ?